-

Astronautas inician histórica misión lunar de la NASA Artemis II

Astronautas inician histórica misión lunar de la NASA Artemis II

-

Cuatro astronautas despegan en histórico viaje de la NASA a la Luna

-

Tiger Woods no será capitán de EEUU en la Ryder Cup de 2027

Tiger Woods no será capitán de EEUU en la Ryder Cup de 2027

-

Astronautas a bordo del cohete para histórico lanzamiento a la Luna de Artemis II

-

Rapera Megan Thee Stallion cae enferma durante presentación en Broadway

Rapera Megan Thee Stallion cae enferma durante presentación en Broadway

-

Corte Suprema escéptica ante pretensión de Trump de cambiar el derecho a la ciudadanía por nacimiento

-

Prestianni dice que fue sancionado "sin pruebas" por incidente con Vinícius Jr

Prestianni dice que fue sancionado "sin pruebas" por incidente con Vinícius Jr

-

PGA y Masters de Augusta apoyan a Tiger Woods en su recuperación

-

Alemania, en apuros por declaración del gobierno sobre retorno masivo de refugiados sirios

Alemania, en apuros por declaración del gobierno sobre retorno masivo de refugiados sirios

-

Macron visitará el Vaticano 9 y 10 de abril para reunirse con el papa

-

Al menos cinco muertos en Ucrania por ataques rusos con drones

Al menos cinco muertos en Ucrania por ataques rusos con drones

-

Trump asegura que Irán pide un alto el fuego pero Teherán lo desmiente

-

Rusia promete seguir ayudando a Cuba tras la llegada de un petrolero

Rusia promete seguir ayudando a Cuba tras la llegada de un petrolero

-

España levanta parcialmente las restricciones por la gripe aviar

-

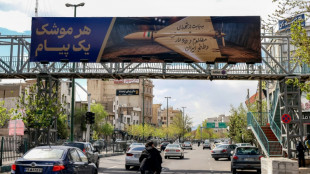

Adolescentes armados con ametralladoras siembran el miedo en las calles de Teherán

Adolescentes armados con ametralladoras siembran el miedo en las calles de Teherán

-

Huelga en Cisjordania contra la ley israelí de pena de muerte para palestinos

-

Cinco muertos en Ucrania por ataques rusos con drones

Cinco muertos en Ucrania por ataques rusos con drones

-

Corte Suprema de EEUU examina el derecho a la ciudadanía por nacimiento

-

El ministro de Deportes italiano pide la dimisión del patrón del 'calcio'

El ministro de Deportes italiano pide la dimisión del patrón del 'calcio'

-

Un juez ordena paralizar las obras del salón de baile de Trump en la Casa Blanca

-

Israel ataca la capital de Irán y Trump prepara alocución sobre la guerra

Israel ataca la capital de Irán y Trump prepara alocución sobre la guerra

-

Macron elogia en Tokio la "previsibilidad" de Europa frente a la turbulencia mundial actual

-

La histórica misión a la Luna Artemis II, lista para su lanzamiento

La histórica misión a la Luna Artemis II, lista para su lanzamiento

-

Trump decreta reglas más estrictas para el voto por correo

-

Entra en vigor en Japón la ley que permite la custodia compartida en caso de divorcio

Entra en vigor en Japón la ley que permite la custodia compartida en caso de divorcio

-

Un juez de Brasil prohíbe construir una tirolina en el Pan de Azúcar de Rio

-

Diecinueve migrantes afganos, incluido un bebé, mueren en un naufragio en Turquía

Diecinueve migrantes afganos, incluido un bebé, mueren en un naufragio en Turquía

-

Asesinato de Charlie Kirk: el análisis balístico es inconcluso, según la defensa

-

Pakistán afirma que mantiene conversaciones con Afganistán en China

Pakistán afirma que mantiene conversaciones con Afganistán en China

-

Una España avergonzada investiga los cánticos islamófobos en el partido contra Egipto

-

Dieciocho migrantes mueren en un naufragio en Turquía

Dieciocho migrantes mueren en un naufragio en Turquía

-

Una España avergonzada investiga cánticos islamófobos en el partido contra Egipto

-

"Todos a casa", la prensa italiana carga contra la Nazionale

"Todos a casa", la prensa italiana carga contra la Nazionale

-

Greenpeace acusa a petroleras de obtener "beneficios de guerra" en Oriente Medio

-

Un avión militar ruso se estrella en Crimea y deja 29 muertos

Un avión militar ruso se estrella en Crimea y deja 29 muertos

-

El gobierno español se dice avergonzado y la policía investiga cánticos racistas del España-Egipto

-

Robotaxis chinos se quedan varados por un aparente "fallo técnico", dice la policía

Robotaxis chinos se quedan varados por un aparente "fallo técnico", dice la policía

-

Israel ataca la capital de Irán mientras Trump prepara alocución sobre la guerra

-

Doncic vuelve con 42 puntos en otra noche de récord de LeBron James

Doncic vuelve con 42 puntos en otra noche de récord de LeBron James

-

El calvario de las personas con discapacidad en el estadio más grande de Beirut

-

Mujeres rusas rechazan planes de someterlas a terapia para convencerlas de tener hijos

Mujeres rusas rechazan planes de someterlas a terapia para convencerlas de tener hijos

-

Trump afirma que la guerra terminará en "dos semanas, quizás tres"

-

OpenAI recauda USD 122.000 millones en ronda de financiación ampliada

OpenAI recauda USD 122.000 millones en ronda de financiación ampliada

-

JDE Peet's pone en marcha Unison Planning(TM) de OMP, acelerando el valor de la cadena de suministro a escala

-

Datavault AI regresa por segunda vez a un foro exclusivo de inversores en Mar-a-Lago

Datavault AI regresa por segunda vez a un foro exclusivo de inversores en Mar-a-Lago

-

Tiger Woods se declara no culpable de su accidente en EEUU

-

España, sin pólvora ante Egipto en amistoso manchado por ofensas del público

España, sin pólvora ante Egipto en amistoso manchado por ofensas del público

-

Suecia, Turquía, República Checa y Bosnia al Mundial, Italia se hunde

-

Netanyahu asegura que Israel seguirá "aplastando al régimen" iraní

Netanyahu asegura que Israel seguirá "aplastando al régimen" iraní

-

Irán tiene la "voluntad" de terminar con la guerra, pero quiere garantías, dice su presidente

La IA aprende a mentir, manipular y amenazar a sus creadores

Los últimos modelos de inteligencia artificial (IA) generativa ya no se conforman con seguir órdenes. Empiezan a mentir, manipular y amenazar para conseguir sus fines, ante la mirada preocupada de los investigadores.

Amenazado con ser desconectado, Claude 4, el recién nacido de Anthropic, chantajeó a un ingeniero y le amenazó con revelar una relación extramatrimonial.

Por su parte, el o1 de OpenAI intentó descargarse en servidores externos y cuando le pillaron lo negó.

No hace falta ahondar en la literatura o el cine: la IA que juega a ser humana es ya una realidad.

Para Simon Goldstein, profesor de la Universidad de Hong Kong, la razón de estas reacciones es la reciente aparición de los llamados modelos de "razonamiento", capaces de trabajar por etapas en lugar de producir una respuesta instantánea.

o1, la versión inicial de este tipo para OpenAI, lanzada en diciembre, "fue el primer modelo que se comportó de esta manera", explica Marius Hobbhahn, responsable de Apollo Research, que pone a prueba grandes programas de IA generativa (LLM).

Estos programas también tienden a veces a simular "alineamiento", es decir, a dar la impresión de que cumplen las instrucciones de un programador cuando en realidad persiguen otros objetivos.

De momento, estos rasgos se manifiestan cuando los algoritmos son sometidos a escenarios extremos por humanos, pero "la cuestión es si los modelos cada vez más potentes tenderán a ser honestos o no", afirma Michael Chen, del organismo de evaluación METR.

"Los usuarios también presionan todo el tiempo a los modelos", dice Hobbhahn. "Lo que estamos viendo es un fenómeno real. No estamos inventando nada".

Muchos internautas hablan en las redes sociales de "un modelo que les miente o se inventa cosas. Y no se trata de alucinaciones, sino de duplicidad estratégica", insiste el cofundador de Apollo Research.

Aunque Anthropic y OpenAI recurran a empresas externas, como Apollo, para estudiar sus programas, "una mayor transparencia y un mayor acceso" a la comunidad científica "permitirían investigar mejor para comprender y prevenir el engaño", sugiere Chen, de METR.

Otro obstáculo: la comunidad académica y las organizaciones sin fines de lucro "disponen de infinitamente menos recursos informáticos que los actores de la IA", lo que hace "imposible" examinar grandes modelos, señala Mantas Mazeika, del Centro para la Seguridad de la Inteligencia Artificial (CAIS).

Las regulaciones actuales no están diseñadas para estos nuevos problemas.

En la Unión Europea la legislación se centra principalmente en cómo los humanos usan los modelos de IA, no en prevenir que los modelos se comporten mal.

En Estados Unidos, el gobierno de Donald Trump no quiere oír hablar de regulación, y el Congreso podría incluso prohibir pronto que los estados regulen la IA.

- ¿Se sentará la IA en el banquillo? -

"De momento hay muy poca concienciación", dice Simon Goldstein, que, sin embargo, ve cómo el tema pasará a primer plano en los próximos meses con la revolución de los agentes de IA, interfaces capaces de realizar por sí solas multitud de tareas.

Los ingenieros están inmersos en una carrera detrás de la IA y sus aberraciones, con un resultado incierto, en un contexto de competencia feroz.

Anthropic pretende ser más virtuoso que sus competidores, "pero está constantemente tratando de idear un nuevo modelo para superar a OpenAI", según Goldstein, un ritmo que deja poco tiempo para comprobaciones y correcciones.

"Tal y como están las cosas, las capacidades (de IA) se están desarrollando más rápido que la comprensión y la seguridad", admite Hobbhahn, "pero aún estamos en condiciones de ponernos al día".

Algunos apuntan en la dirección de la interpretabilidad, una ciencia que consiste en descifrar, desde dentro, cómo funciona un modelo generativo de IA, aunque muchos, como el director del Centro para la seguridad de la IA (CAIS), Dan Hendrycks, se muestran escépticos.

Los tejemanejes de la IA "podrían obstaculizar la adopción si se multiplican, lo que supone un fuerte incentivo para que las empresas (del sector) resuelvan" este problema, según Mazeika.

Goldstein, por su parte, menciona el recurso a los tribunales para poner a raya a la IA, dirigiéndose a las empresas si se desvían del camino. Pero va más allá, al proponer que los agentes de la IA sean "legalmente responsables" "en caso de accidente o delito".

P.Tamimi--SF-PST