-

La Nasa publie la photo d'un sublime coucher de Terre, les astronautes d'Artémis sur le retour

La Nasa publie la photo d'un sublime coucher de Terre, les astronautes d'Artémis sur le retour

-

Monte-Carlo: Sinner et Alcaraz se baladent, Monfils dit adieu au Rocher

-

Le rappeur Offset blessé par balle en Floride

Le rappeur Offset blessé par balle en Floride

-

Kanye West interdit d'entrée au Royaume-Uni en raison de ses propos antisémites

-

Intempéries au Pakistan et en Afghanistan: le bilan s'alourdit à 188 morts

Intempéries au Pakistan et en Afghanistan: le bilan s'alourdit à 188 morts

-

Trafic de pesticides: prison ferme contre un fournisseur et un important maraîcher

-

Moyen-Orient: les marchés mondiaux sous tension après le dernier ultimatum de Donald Trump

Moyen-Orient: les marchés mondiaux sous tension après le dernier ultimatum de Donald Trump

-

Financement libyen: Guéant et Hortefeux ont commis une "erreur" lors de leurs voyages à Tripoli, estime Sarkozy

-

Google ajoute des garde-fous à son IA pour prévenir la dépendance des jeunes

Google ajoute des garde-fous à son IA pour prévenir la dépendance des jeunes

-

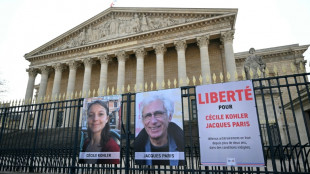

Iran: les ex-détenus Cécile Kohler et Jacques Paris bientôt de retour en France

-

Wall Street ouvre en baisse, l'ultimatum de Trump à l'Iran en ligne de mire

Wall Street ouvre en baisse, l'ultimatum de Trump à l'Iran en ligne de mire

-

Cécile Kohler et Jacques Paris, la fin du cauchemar de deux enseignants qui rêvaient d'Iran

-

Monte-Carlo: Sinner et Alcaraz en balade pour leur entrée en lice

Monte-Carlo: Sinner et Alcaraz en balade pour leur entrée en lice

-

Pas-de-Calais: un conducteur de TGV tué dans un accident, un chauffeur routier en garde à vue

-

Iran: les ex-détenus Cécile Kohler et Jacques Paris "sont libres et en chemin vers le territoire français", annonce Macron

Iran: les ex-détenus Cécile Kohler et Jacques Paris "sont libres et en chemin vers le territoire français", annonce Macron

-

La Nasa publie la photo d'un coucher de Terre prise par les astronautes d'Artémis

-

Céline Dion ajoute six nouvelles dates de concert à Paris

Céline Dion ajoute six nouvelles dates de concert à Paris

-

Blocage du détroit d'Ormuz: quels sont les pays dont les bateaux sont les plus touchés?

-

Carburants: près d'une station sur cinq en rupture après Pâques, nouvelles aides envisagées

Carburants: près d'une station sur cinq en rupture après Pâques, nouvelles aides envisagées

-

Espagne: premier jour du procès pour corruption d'un ancien proche du Premier ministre

-

A Cuba, une nouvelle génération de Castro: des politiques et un influenceur

A Cuba, une nouvelle génération de Castro: des politiques et un influenceur

-

Egypte: Eni annonce la découverte d'un important gisement de gaz offshore

-

Le vice-président américain JD Vance est arrivé en Hongrie avant les législatives de dimanche

Le vice-président américain JD Vance est arrivé en Hongrie avant les législatives de dimanche

-

Face à la polémique, Kanye West propose de rencontrer la communauté juive britannique

-

"L'heure des crocs", le réquisitoire de Philippe Bilger contre CNews, son ancienne chaîne

"L'heure des crocs", le réquisitoire de Philippe Bilger contre CNews, son ancienne chaîne

-

Turquie : fusillade devant le consulat israélien à Istanbul, un assaillant tué

-

Carburants: des pêcheurs mobilisés en Corse et au Havre

Carburants: des pêcheurs mobilisés en Corse et au Havre

-

"Cirque" ou exercice de transparence ? Fin de la commission sur l'audiovisuel public

-

Trente ans après la guerre, la Croatie libérée des mines, pas des blessures

Trente ans après la guerre, la Croatie libérée des mines, pas des blessures

-

Inde: démission du patron d'Air India, Campbell Wilson

-

Nouvelles frappes en Iran à quelques heures du terme de l'ultimatum de Trump

Nouvelles frappes en Iran à quelques heures du terme de l'ultimatum de Trump

-

Nouvelle grève des médecins en Angleterre, la 15e en près de trois ans

-

Cinq choses à savoir sur les free parties au centre d'une proposition de loi

Cinq choses à savoir sur les free parties au centre d'une proposition de loi

-

Prix du livre politique: l'ex-roi d'Espagne en exil Juan Carlos à l'honneur

-

Procès libyen: à la "souffrance" des victimes, Sarkozy oppose la "vérité" de son innocence

Procès libyen: à la "souffrance" des victimes, Sarkozy oppose la "vérité" de son innocence

-

Espagne: le procès de l'ancien bras droit du Premier ministre s'est ouvert à Madrid

-

Un Cambodgien expulsé des Etats-Unis raconte la "misère" de la prison en Eswatini

Un Cambodgien expulsé des Etats-Unis raconte la "misère" de la prison en Eswatini

-

Carburants: 18% de stations en rupture temporaire, nouvelles aides ciblées en préparation

-

Procès libyen: à la "souffrance" des parties civiles, Sarkozy veut répondre par "la vérité" de son innocence

Procès libyen: à la "souffrance" des parties civiles, Sarkozy veut répondre par "la vérité" de son innocence

-

Moyen-Orient: la Bourse de Paris prudente dans un contexte incertain

-

Des photos oubliées des Beatles exhumées avant les 60 ans de leurs concerts au Japon

Des photos oubliées des Beatles exhumées avant les 60 ans de leurs concerts au Japon

-

Moyen-Orient: les Bourses européennes sous le signe de la volatilité

-

Un ex-soldat australien inculpé pour des crimes de guerre présumés en Afghanistan

Un ex-soldat australien inculpé pour des crimes de guerre présumés en Afghanistan

-

Prix des carburants: de prochaines aides ciblées pour certaines professions, confirme Bregeon

-

A Rio, les bus en première ligne dans la guerre entre narcotrafiquants et police

A Rio, les bus en première ligne dans la guerre entre narcotrafiquants et police

-

Carburants: environ 18% des stations-service en rupture de stock, annonce Bregeon

-

Les faux chanteurs IA percent dans la musique country, victime de son immense succès commercial

Les faux chanteurs IA percent dans la musique country, victime de son immense succès commercial

-

Bruit, polluants: les travailleurs du BTP bien plus exposés, selon une étude de Santé publique France

-

Les actrices de "Drôles de dames" ont fêté les 50 ans de la série à Hollywood

Les actrices de "Drôles de dames" ont fêté les 50 ans de la série à Hollywood

-

IA: Anthropic entrevoit un chiffre d'affaires supérieur à son rival OpenAI

Google ajoute des garde-fous à son IA pour prévenir la dépendance des jeunes

Google a dévoilé mardi une série de modifications censées empêcher son assistant d'intelligence artificielle (IA) générative de se comporter en compagnon et de risquer de rendre les jeunes dépendants à son interface.

Ces garde-fous doivent notamment interdire à Gemini de "prétendre être humain ou posséder des attributs humains", a expliqué la filiale d'Alphabet dans un communiqué.

Google a ajouté à son modèle des "protections conçues pour prévenir la dépendance émotionnelle, éviter tout langage qui simule l'intimité ou exprime des besoins", a ajouté le groupe de Mountain View (Californie).

Les interactions entre adolescents et applications d'IA générative sont un sujet de préoccupation pour de nombreux parents, associations et élus.

En avril 2025, l'ONG américaine Common Sense a recommandé d'interdire aux mineurs les interfaces d'IA se présentant comme des compagnons virtuels, notamment Character.AI et Replika.

S'ils ne sont pas conçus ou promus de cette façon, les assistants IA les plus connus comme ChatGPT, Claude ou Gemini sont aussi utilisés comme tels par de nombreux adolescents.

Un tiers des 13-17 ans interrogés dans le cadre d'une étude commandée, au printemps 2025, par Common Sense indiquaient se servir de ces logiciels IA pour "des interactions sociales et des relations".

En janvier, Google et Character.AI ont conclu des accords amiables pour solder des poursuites lancées par des familles accusant des robots conversationnels de nuire à des mineurs et d'avoir contribué au suicide de l'un d'entre eux.

Mardi toujours, Google a également annoncé de nouvelles fonctionnalités en matière de santé mentale pour les utilisateurs de Gemini.

Si l'interface détecte des signes selon lesquels l'internaute songe au suicide ou à l'auto-mutilation, elle fera apparaître un lien direct vers un centre de soutien psychologique, en ligne ou téléphonique.

"Gemini peut être un outil utile pour apprendre et trouver de l'information, ce n'est pas un substitut à l'intervention d'un professionnel de santé, à une thérapie ou un soutien en cas de crise", souligne Google.

En cas d'alerte, Gemini a été entraîné "à répondre de façon appropriée en orientant (l'utilisateur) vers une assistance humaine".

A.AlHaj--SF-PST