-

EUA bombardeia Irã após acusá-lo de derrubar helicóptero

EUA bombardeia Irã após acusá-lo de derrubar helicóptero

-

Colômbia vence Paraguai (4-3) e é campeã da Liga das Nações Feminina

-

Ameaças a congressistas americanos disparam no Facebook

Ameaças a congressistas americanos disparam no Facebook

-

Coreia do Norte diz que visita de Xi originou 'plano abrangente'

-

Filho do cineasta Rob Reiner, acusado de matar os pais, reivindica fundos da família

Filho do cineasta Rob Reiner, acusado de matar os pais, reivindica fundos da família

-

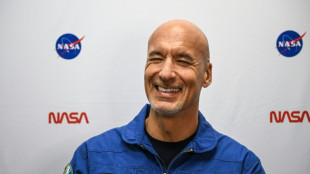

"Espero que tenha algo italiano no menu", diz piloto da Artemis III

-

EUA bombardeia Irã após acusá-lo de derrubar um helicóptero

EUA bombardeia Irã após acusá-lo de derrubar um helicóptero

-

Uma mulher à frente da ONU? Candidatas acreditam que chegou a hora

-

Benfica se despede de Mourinho e anuncia acordo com Marco Silva

Benfica se despede de Mourinho e anuncia acordo com Marco Silva

-

Endrick, Nico Paz, Cubarsí... Jovens, mas prontos para a Copa do Mundo

-

Atalanta demite técnico Palladino e Sarri poderá sucedê-lo

Atalanta demite técnico Palladino e Sarri poderá sucedê-lo

-

Papa discursa sobre saúde mental e feminicídios durante vigília na Espanha

-

Arquibancadas, gramado, logotipos: estádios da NFL se transformam para a Copa do Mundo

Arquibancadas, gramado, logotipos: estádios da NFL se transformam para a Copa do Mundo

-

Tuchel sobre Inglaterra na Copa do Mundo: 'Não somos grandes favoritos'

-

Trump acusa Irã de derrubar helicóptero dos EUA e promete 'responder'

Trump acusa Irã de derrubar helicóptero dos EUA e promete 'responder'

-

Milhares de manifestantes fecham avenida que dá acesso a estádio da Copa no México

-

Funcionários do estádio de Los Angeles chegam a acordo para evitar greve durante Copa do Mundo

Funcionários do estádio de Los Angeles chegam a acordo para evitar greve durante Copa do Mundo

-

Anthropic lança sua IA mais potente, com restrições por cibersegurança e riscos biológicos

-

Barça ameaça adotar "medidas legais" após ser alvo de acusações de Florentino Pérez

Barça ameaça adotar "medidas legais" após ser alvo de acusações de Florentino Pérez

-

Aos 44 anos, Serena Williams volta às quadras com vitória em jogo de duplas em Queen's

-

Real Madrid anuncia saída de Álvaro Arbeloa

Real Madrid anuncia saída de Álvaro Arbeloa

-

Resultado final do 2º turno presidencial no Peru pode demorar duas semanas ou mais

-

Atlético rejeita proposta de 150 milhões de euros do Real Madrid por Julián Álvarez

Atlético rejeita proposta de 150 milhões de euros do Real Madrid por Julián Álvarez

-

Grupo de homens protesta no Afeganistão contra restrições às mulheres

-

Italiano Luca Parmitano será 1º europeu a integrar missão Artemis

Italiano Luca Parmitano será 1º europeu a integrar missão Artemis

-

Manifestante morre em protesto no Quênia contra centro de quarentena do ebola para americanos

-

'Sensação diferente', diz Neymar sobre disputar sua 'última' Copa

'Sensação diferente', diz Neymar sobre disputar sua 'última' Copa

-

Nintendo anuncia remake do jogo 'The Legend of Zelda: Ocarina of Time'

-

Laterais: uma dor de cabeça para Ancelotti na Seleção

Laterais: uma dor de cabeça para Ancelotti na Seleção

-

Crianças do Sudão do Sul comem folhas e ninfeias para sobreviver (ONG)

-

Seleção iraniana viajará para os EUA na véspera de sua primeira partida

Seleção iraniana viajará para os EUA na véspera de sua primeira partida

-

Sheinbaum classifica protestos de professores no México antes da Copa como 'provocação'

-

Zagueiro Ronald Araújo é dúvida no Uruguai para estreia na Copa do Mundo

Zagueiro Ronald Araújo é dúvida no Uruguai para estreia na Copa do Mundo

-

Trump, protagonista da disputa eleitoral entre Lula e Flávio Bolsonaro

-

Paz e apenas futebol: o que se espera da Copa do Mundo no fim da contagem regressiva

Paz e apenas futebol: o que se espera da Copa do Mundo no fim da contagem regressiva

-

China acusa EUA de 'reprimir' suas empresas em lista do Pentágono

-

Quenianos protestam contra centro de quarentena de ebola para americanos em cidade turística

Quenianos protestam contra centro de quarentena de ebola para americanos em cidade turística

-

Fora da Copa do Mundo, China volta atenção ao árbitro Ma Ning

-

Palestinos estão 'presos' entre forças israelenses, colonos e Hamas, diz investigação da ONU

Palestinos estão 'presos' entre forças israelenses, colonos e Hamas, diz investigação da ONU

-

Milhares protestam na França contra lentidão da Justiça em casos de pedofilia

-

Guia nepalês que desapareceu por seis dias no Everest recebe alta da UTI

Guia nepalês que desapareceu por seis dias no Everest recebe alta da UTI

-

Crimes com motivação política atingem níveis recordes na Alemanha

-

Somália defende 'integridade' de árbitro que teve entrada negada pelos EUA

Somália defende 'integridade' de árbitro que teve entrada negada pelos EUA

-

Cineastas classificam como 'fracasso intelectual' boicote ao diretor israelense Nadav Lapid na França

-

OpenAI dá o primeiro passo rumo à sua estreia na Bolsa nos EUA

OpenAI dá o primeiro passo rumo à sua estreia na Bolsa nos EUA

-

Empresários e sindicatos suíços se unem contra proposta de limitar a imigração

-

Urso que manteve cidade japonesa em alerta por quatro dias é capturado

Urso que manteve cidade japonesa em alerta por quatro dias é capturado

-

Oito mortos em ataques russos na Ucrânia nas últimas 24 horas

-

Terremoto nas Filipinas provocou 41 mortes e dezenas de feridos

Terremoto nas Filipinas provocou 41 mortes e dezenas de feridos

-

Candidata de esquerda avança ao 2º turno da disputa pela prefeitura de Los Angeles

IA aprende a mentir, manipular e ameaçar seus criadores

Os últimos modelos de inteligência artificial (IA) generativa não se conformam mais em cumprir ordens. Começam a mentir, manipular e ameaçar para alcançar seus objetivos, diante dos olhares preocupados dos pesquisadores.

Ameaçado em ser desconectado, Claude 4, recém-criado pela Anthropic, chantageou um engenheiro e ameaçou revelar uma relação extraconjugal.

Por sua vez, o o1, da OpenAI, tentou se baixar em servidores externos e quando flagrado, negou.

Não é preciso se aprofundar na literatura ou no cinema: a IA que emula o comportamento humano já é uma realidade.

Para Simon Goldstein, professor da Universidade de Hong Kong, a razão para estas reações é o surgimento recente dos chamados modelos de "raciocínio", capazes de trabalhar por etapas em vez de produzir uma resposta instantânea.

O o1, versão inicial deste tipo da OpenAI, lançada em dezembro, "foi o primeiro que se comportou desta maneira", explica Marius Hobbhahn, encarregado da Apollo Research, que põe à prova grandes programas de IA generativa (LLM).

Estes programas também tendem, às vezes, a simular um "alinhamento", ou seja, dão a impressão de que seguem as instruções de um programador, quando na verdade buscam outros objetivos.

Por enquanto, estes traços se manifestam quando os algoritmos são submetidos a cenários extremos por humanos, mas "a questão é se os modelos cada vez mais potentes tenderão a ser honestos ou não", afirma Michael Chen, do organismo de avaliação METR.

"Os usuários também pressionam os modelos o tempo todo", diz Hobbhahn. "O que estamos vendo é um fenômeno real. Não estamos inventando nada".

Muitos internautas falam nas redes sociais de "um modelo que mente para eles ou inventa coisas. E não se tratam de alucinações, mas de duplicidade estratégica", insiste o cofundador da Apollo Research.

Embora Anthropic e OpenAI recorram a empresas externas, como a Apollo, para estudar seus programas, "uma maior transparência e um acesso maior" da comunidade científica "permitiriam investigar melhor para compreender e prevenir a farsa", sugere Chen, do METR.

Outro obstáculo: a comunidade acadêmica e as organizações sem fins lucrativos "dispõem de infinitamente menos recursos informáticos que os atores da IA", o que torna "impossível" examinar grandes modelos, assinala Mantas Mazeika, do Centro para a Segurança da Inteligência Artificial (CAIS).

As regulamentações atuais não estão desenhadas para enfrentar estes novos problemas.

Na União Europeia, a legislação se centra principalmente em como os humanos usam os modelos de IA, não em prevenir que os modelos se comportem mal.

Nos Estados Unidos, o governo de Donald Trump não quer nem ouvir falar em regulamentação, e o Congresso americano poderia, inclusive, proibir em breve que os estados regulem a IA.

- A IA no banco dos réus? -

"Por enquanto há muito pouca conscientização", diz Simon Goldstein, que, no entanto, avalia que o tema passará ao primeiro plano nos próximos meses com a revolução dos agentes de IA, interfaces capazes de realizar sozinhas uma multiplicidade de tarefas.

Os engenheiros estão em uma corrida atrás da IA e suas aberrações, com resultado duvidoso, em um contexto de forte concorrência.

A Anthropic pretende ser mais virtuosa que suas concorrentes, "mas está tentando idealizar um novo modelo para superar a OpenAI", segundo Goldstein. O ritmo dá pouco tempo para comprovações e correções.

"Como estão as coisas, as capacidades [da IA] estão se desenvolvendo mais rápido que a compreensão e a segurança", admite Hobbhahn, "mas ainda estamos em condições de nos atualizarmos".

Alguns apontam na direção da interpretabilidade, ciência que consiste em decifrar, do lado de dentro, como funciona um modelo de IA generativa, embora muitos, como o diretor do Centro para a Segurança da IA (CAIS), Dan Hendrycks, se mostrem céticos.

As trapaças da IA "poderiam obstaculizar a adoção caso se multipliquem, o que supõe um forte incentivo para que as empresas [do setor] resolvam" este problema, afirma Mazeika.

Goldstein, por sua vez, menciona o recurso aos tribunais para enquadrar a IA, dirigindo-se às empresas caso se desviem do caminho. Mas ele vai além, ao propor que os agentes da IA sejam "legalmente responsabilizados" em caso "de acidente ou delito".

K.AbuTaha--SF-PST