-

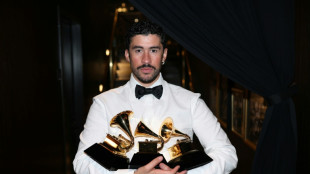

Apostas no Super Bowl enlouquecem com apresentação de Bad Bunny

Apostas no Super Bowl enlouquecem com apresentação de Bad Bunny

-

Guterres considera fim do acordo nuclear entre EUA e Rússia um 'momento sério' para a paz

-

EUA e Irã terão conversas nucleares nesta semana em Omã

EUA e Irã terão conversas nucleares nesta semana em Omã

-

Lesionado, Shai Gilgeous-Alexander está fora do All-Star Game da NBA

-

Stuttgart vence Holstein Kiel (3-0) e se garante nas semifinais da Copa da Alemanha

Stuttgart vence Holstein Kiel (3-0) e se garante nas semifinais da Copa da Alemanha

-

City volta a vencer Newcastle e vai à final da Copa da Liga contra o Arsenal

-

Com golaço de Endrick, Lyon vence Laval (2-0) e vai às quartas da Copa da França

Com golaço de Endrick, Lyon vence Laval (2-0) e vai às quartas da Copa da França

-

Governo Trump provoca 'erosão democrática' na América Latina, alerta ONG

-

Vítimas de tragédia em Mariana esperam justiça por 'um crime muito grande'

Vítimas de tragédia em Mariana esperam justiça por 'um crime muito grande'

-

Hayes, do Lakers, é suspenso por empurrar mascote do Washington Wizards

-

Envolvido no Caso Epstein, chefe dos Jogos de Los Angeles 2028 é pressionado a renunciar

Envolvido no Caso Epstein, chefe dos Jogos de Los Angeles 2028 é pressionado a renunciar

-

Rússia afirma que não está mais ligada ao tratado Novo Start

-

Martínez segue retido na Venezuela enquanto Corinthians aguarda

Martínez segue retido na Venezuela enquanto Corinthians aguarda

-

Principal cartel colombiano suspende diálogos de paz após acordo entre Petro e Trump

-

EUA anuncia retirada 'imediata' de 700 agentes de imigração de Minnesota

EUA anuncia retirada 'imediata' de 700 agentes de imigração de Minnesota

-

Pogba fica fora de lista de jogadores do Monaco para mata-mata da Liga dos Campeões

-

Panamá rejeita ameaça da China por anulação de contrato portuário no canal

Panamá rejeita ameaça da China por anulação de contrato portuário no canal

-

Xi pede a Trump 'respeito mútuo' e elogia vínculo com Putin

-

Argentina escolhe Kansas City como base para Copa do Mundo de 2026

Argentina escolhe Kansas City como base para Copa do Mundo de 2026

-

Após Musk, proprietário do Telegram critica premiê espanhol por seus planos para redes sociais

-

EUA anuncia alianças sobre terras raras com UE, Japão e México

EUA anuncia alianças sobre terras raras com UE, Japão e México

-

Ataques israelenses deixam ao menos 25 mortos em Gaza

-

Após Musk, proprietário do Telegram critica Sánchez por seus planos para redes sociais

Após Musk, proprietário do Telegram critica Sánchez por seus planos para redes sociais

-

Homem que tentou matar Trump na Flórida em 2024 é condenado à prisão perpétua

-

Washington Post anuncia 'doloroso' plano de demissões

Washington Post anuncia 'doloroso' plano de demissões

-

Documentário da Netflix analisa caso de Lucy Letby, enfermeira britânica condenada por matar bebês

-

Ucrânia diz que diálogo com Rússia em Abu Dhabi é 'produtivo'

Ucrânia diz que diálogo com Rússia em Abu Dhabi é 'produtivo'

-

Irã autoriza formalmente mulheres a pilotar motocicletas

-

'Ajoelhados, jamais': Venezuela relembra aniversário do golpe de Chávez

'Ajoelhados, jamais': Venezuela relembra aniversário do golpe de Chávez

-

Restaurador apaga pintura polêmica com rosto de Giorgia Meloni

-

Desinformação sobre o câncer pode atrasar tratamento ou levar à morte

Desinformação sobre o câncer pode atrasar tratamento ou levar à morte

-

Centros de dados em órbita são uma possibilidade diante da demanda de energia para IA

-

Governo alemão recua e descarta boicote à Copa do Mundo de 2026

Governo alemão recua e descarta boicote à Copa do Mundo de 2026

-

Principal cartel colombiano suspende negociações de paz após acordo entre Trump e Petro

-

Vítimas da tragédia em Mariana esperam justiça por um 'crime muito grande'

Vítimas da tragédia em Mariana esperam justiça por um 'crime muito grande'

-

Aliança China-Rússia é um 'fator de estabilidade', disse Putin a Xi

-

Ucrânia, Rússia e EUA se reúnem em Abu Dhabi para negociar a paz

Ucrânia, Rússia e EUA se reúnem em Abu Dhabi para negociar a paz

-

Fenerbahçe acerta contratação de Kanté após intervenção do presidente da Turquia

-

Novo Start, o fim de um tratado nuclear de outra época

Novo Start, o fim de um tratado nuclear de outra época

-

Arábia Saudita emitirá passaportes para camelos

-

Ex-príncipe Andrew deixa Windsor, mas segue no olho do furacão

Ex-príncipe Andrew deixa Windsor, mas segue no olho do furacão

-

Ataques israelenses em Gaza deixam ao menos 21 mortos

-

Colômbia e EUA convidarão Venezuela a se juntar à sua nova ofensiva antidrogas

Colômbia e EUA convidarão Venezuela a se juntar à sua nova ofensiva antidrogas

-

Negociadores da Ucrânia, Rússia e EUA se reúnem em Abu Dhabi para negociar a paz

-

Acusado de estupro, filho da princesa de Noruega reconhece uma vida de excessos

Acusado de estupro, filho da princesa de Noruega reconhece uma vida de excessos

-

CK Hutchison aciona arbitragem contra Panamá após anulação de sua concessão no canal

-

Milei ante o dilema de negociar com a China e agradar a Trump

Milei ante o dilema de negociar com a China e agradar a Trump

-

Ciência lança luz sobre os grafites de Pompeia

-

Takaichi, a primeira-ministra japonesa que cativa a Geração Z

Takaichi, a primeira-ministra japonesa que cativa a Geração Z

-

ONGs lutam para contabilizar os mortos da repressão no Irã

Gigantes americanas da IA se unem para buscar autorregulação

Google, Microsoft, Anthropic e OpenAI, quatro das empresas americanas que lideram o cenário da Inteligência Artificial (IA) de última geração, anunciaram nesta quarta-feira (26) a criação de um novo órgão profissional para combater os riscos associados a esta tecnologia.

O "Frontier Model Forum" terá a responsabilidade de promover o "desenvolvimento responsável" dos modelos de IA mais sofisticados e "minimizar os potenciais riscos", de acordo com um comunicado à imprensa.

Assim, os membros se comprometem a compartilhar boas práticas entre si e com legisladores, pesquisadores e associações, para que esses sistemas sejam menos perigosos.

A rápida implantação da IA generativa, por meio de plataformas como ChatGPT (OpenAI), Bing (Microsoft) ou Bard (Google), está gerando preocupação entre autoridades e a sociedade civil.

A União Europeia (UE) está finalizando um projeto de regulação desta tecnologia que deve impor obrigações às empresas do setor, como transparência com os usuários ou controle humano sobre as máquinas.

Já nos Estados Unidos, as tensões políticas com o Congresso impedem qualquer esforço neste campo.

Esta é uma das razões pelas quais a Casa Branca pede que as partes interessadas garantam a segurança de seus produtos, em nome de seu "dever moral", afirmou a vice-presidente americana, Kamala Harris, no início de maio.

Na semana passada, o governo de Joe Biden garantiu os "compromissos" da Amazon, Anthropic, Google, Inflection, Meta, Microsoft e OpenAI para defender "três princípios" no desenvolvimento de IA: segurança, proteção e confiança.

Supõe-se que estas empresas devem testar seus programas antecipadamente, combater ataques cibernéticos e fraudes e encontrar maneiras de sinalizar que o conteúdo foi gerado por IA, para que seja claramente autenticado como tal.

Os dirigentes destas companhias também não negam os riscos.

Em junho, Sam Altman, diretor da OpenAI, e Demis Hassabis, presidente da DeepMind (Google), exortaram a luta contra "os riscos de extinção" da humanidade "ligada à IA".

Durante uma audiência no Congresso, Altman endossou a ideia cada vez mais popular de criar uma agência internacional encarregada da regulação da inteligência artificial, como as que existem em outros campos.

Enquanto isso, a OpenAI está trabalhando em uma IA chamada "geral", com habilidades cognitivas semelhantes às dos humanos.

Em uma publicação de 6 de julho, a empresa abordou que tem como foco os "modelos de fronteira" da IA, "modelos fundamentais altamente sofisticados que poderiam adquirir capacidades perigosas suficientes para oferecer sérios riscos à segurança pública".

A gigante americana ainda alerta que esses recursos perigosos podem "surgir inesperadamente" e que "é realmente difícil impedir que um modelo implantado seja mal utilizado".

J.AbuShaban--SF-PST