-

Presidente della Fondazione Museo della Shoah alla Giornata della Memoria in Canada

Presidente della Fondazione Museo della Shoah alla Giornata della Memoria in Canada

-

All'asta la chitarra di Kurt Cobain, 'può valere fino a 5 milioni'

-

Coppa Italia: Juventus battuta 3-0, Atalanta in semifinale

Coppa Italia: Juventus battuta 3-0, Atalanta in semifinale

-

Essere scelti e fragilità, Cesare Cremonini incontra gli studenti Unical

-

Milano Cortina: Piazza Duomo accoglie la fiamma, acceso il braciere

Milano Cortina: Piazza Duomo accoglie la fiamma, acceso il braciere

-

Il 'teatrante militante' Servillo ai giovani: camminate insieme

-

Dalla Via Lattea il principale indizio delle origini cosmiche della vita sulla Terra

Dalla Via Lattea il principale indizio delle origini cosmiche della vita sulla Terra

-

Zelensky, 'probabilmente in Usa i prossimi colloqui'

-

In Fvg prime banchine portuali in Italia elettrificate con fotovoltaico

In Fvg prime banchine portuali in Italia elettrificate con fotovoltaico

-

Europei pallanuoto: Setterosa ko, il bronzo va alla Grecia

-

Ghali, 'non ho più potuto cantare l'inno d'Italia'

Ghali, 'non ho più potuto cantare l'inno d'Italia'

-

Mosca, 'accuse di Tajani su cyberattacchi sono calunnie'

-

Il governo Milei lancia il suo ufficio 'contro la disinformazione'

Il governo Milei lancia il suo ufficio 'contro la disinformazione'

-

Fonti Farnesina ad amb. Mosca, 'cyberattacchi rivendicati da filorussi'

-

Salvezza possibile per il cielo più buio e limpido al mondo

Salvezza possibile per il cielo più buio e limpido al mondo

-

Borsa: Milano debole con Wall street e l'Europa, male Stellantis e le banche

-

Il gas conclude in leggero rialzo (+0,7%) a 33,7 euro al Megawattora

Il gas conclude in leggero rialzo (+0,7%) a 33,7 euro al Megawattora

-

Enel, nel 2025 mol ordinario +2,2%, utile netto fra 6,7 e 6,9 miliardi

-

Lula, il rientro di Maduro in Venezuela 'non è la principale preoccupazione'

Lula, il rientro di Maduro in Venezuela 'non è la principale preoccupazione'

-

Confapi, roadshow con Sace e Simest per l'internazionalizzazione delle pmi

-

Pirelli boccia la proposta dei cinesi di Cnrc su Cyber Tyre

Pirelli boccia la proposta dei cinesi di Cnrc su Cyber Tyre

-

Milano 84 rilegge gli anni '80 con Nostaljoy two

-

Borsa: l'Europa conclude debole, Madrid -2,1%

Borsa: l'Europa conclude debole, Madrid -2,1%

-

Borsa: Milano chiude in forte calo, Ftse Mib -1,75%

-

Ai piedi del Monviso delle insolite stalagmiti di ghiaccio

Ai piedi del Monviso delle insolite stalagmiti di ghiaccio

-

Golino, 'nella fragilità di Gioia ho messo la mia anima'

-

Europei pista: Balsamo e Venturelli bronzo nella madison

Europei pista: Balsamo e Venturelli bronzo nella madison

-

Regina (Confindustria), dal nucleare dipendono competività e benessere

-

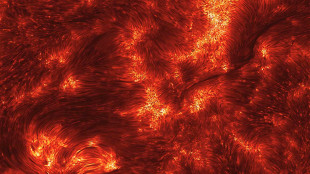

Brillamenti solari come le valanghe, al via da piccole perturbazioni

Brillamenti solari come le valanghe, al via da piccole perturbazioni

-

Sei Nazioni: Quesada 'l'immagine è cambiata, oggi è sorpresa se vince la Scozia'

-

Borsa: l'Europa resta debole dopo Wall street, Milano molto nervosa

Borsa: l'Europa resta debole dopo Wall street, Milano molto nervosa

-

Parisi, sbagliato tornare al nucleare, puntiamo sul solare

-

Fifa: mercato di riparazione, solo la Premier spende piu' della serie A

Fifa: mercato di riparazione, solo la Premier spende piu' della serie A

-

Calcio: Vergara, 'con Conte come a scuola, mi insegna a non staccare mai la testa'

-

Atletica: domani Battocletti a Madrid, esordio indoor nei 1.500

Atletica: domani Battocletti a Madrid, esordio indoor nei 1.500

-

Wall Street apre in calo, Dj -0,49%, Nasdaq -1,37%

-

Il petrolio è in calo a New York a 63,48 dollari

Il petrolio è in calo a New York a 63,48 dollari

-

Salmo annuncia l'album Hellvisback 10 years later

-

Milano Cortina: ampia copertura su Sky, la Casa dello sport diventa 'Casa Italia'

Milano Cortina: ampia copertura su Sky, la Casa dello sport diventa 'Casa Italia'

-

Al via le celebrazioni per i 50 anni del Metodo Suzuki in Italia

-

Haftar e Hammad in Pakistan, allo studio consolato a Bengasi

Haftar e Hammad in Pakistan, allo studio consolato a Bengasi

-

Borsa: Milano (-1,3%) e l'Europa peggiorano in attesa di Wall street

-

Strumento di IA può 'leggere' l'età del cervello ed il rischio Alzheimer

Strumento di IA può 'leggere' l'età del cervello ed il rischio Alzheimer

-

Tropico in concerto a Pompei per la rassegna 'B.O.P. 2026'

-

Ditonellapiaga annuncia la release del nuovo album Miss Italia, fuori il 10 aprile

Ditonellapiaga annuncia la release del nuovo album Miss Italia, fuori il 10 aprile

-

Codacons, rischio spegnimento non solo autovelox ma anche tutor in autostrada

-

Lagarde, sul commercio internazionale pesano i dazi e l'euro forte

Lagarde, sul commercio internazionale pesano i dazi e l'euro forte

-

Aviaria, Veneto prima regione italiana ad avviare la campagna vaccinale in allevamenti

-

A Roma Accademia Bizantina con i Concerti Brandeburghesi

A Roma Accademia Bizantina con i Concerti Brandeburghesi

-

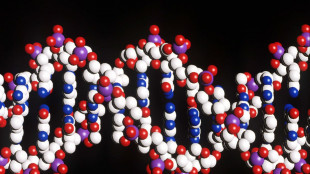

Errori nella riparazione del Dna alla base della perdita di abilità

Minerva 7B, nuova versione della risposta italiana a ChatGpt

Ha 7 miliardi di parametri, più del doppio di quella precedente

Minerva, la risposta italiana all'Intelligenza Artificiale come ChatGpt, cresce e diventa più sicura: si chiama Minerva7B, dove 7B sta per 7 miliardi di parametri, più del doppio di quella precedente. L'ultima versione dell'Intelligenza Artificiale interamente addestrata da zero in italiano, sotto la guida di Roberto Navigli del Natural Language Processing dell'Università Sapienza di Roma, è stata presentata oggi nella stessa università. Accessibile per tutti all'indirizzo https://minerva-llm.org , Minerva7B è un progetto sviluppato dal gruppo di ricerca Sapienza Nlp all'interno del Future Artificial Intelligence Research, il progetto che realizza la strategia nazionale sull'intelligenza artificiale grazie ai fondi Pnrr, e in collaborazione con Cineca che ha reso disponibile il supercomputer Leonardo. "Oggi presentiamo il primo modello pre-addestrato in lingua italiana stile ChatGpt, quindi un modello linguistico, che si chiama Minerva 7B", ha detto Navigli. "E' un modello che è addestrato anche per rispondere a domande e istruzioni, comandi ed è particolarmente interessante perché abbiamo fatto un lavoro importante sulla sicurezza del modello, la cosiddetta safety, cioè la capacità del modello di evitare e rispondere a domande che potrebbe portare alla generazione di contenuti indesiderati o malevoli". Evoluzione e miglioramento del precedente modello che contava 3 miliardi di parametri, Minerva 7B ha una maggior capacità di memorizzazione e rielaborazione dei testi, sempre basata su fonti aperte di dati che spaziano da Wikipedia e grandi archivi aperti di libri come il progetto Gutemberg. "A differenza di ChatGpt o Gemini, che sono modelli chiusi così come anche Mistral o Llama3 che sono scaricabili, Minerva appartiene a quella ristretta famiglia di modelli aperti, ossia che è possibile analizzare liberamente", ha aggiunto Navigli. .

M.AbuKhalil--SF-PST