-

Venezuela, il legale dell'ex ministro Alex Saab smentisce il suo arresto

Venezuela, il legale dell'ex ministro Alex Saab smentisce il suo arresto

-

Colombia, il Consiglio elettorale esclude Iván Cepeda dalle primarie della sinistra

-

Argentina-Usa, intesa sui minerali critici

Argentina-Usa, intesa sui minerali critici

-

Coppa Italia: Chivu, abbiamo sofferto un po' nel finale ma siamo contenti

-

Milano Cortina: slittino, Fischnaller subito veloce allo Sliding Centre

Milano Cortina: slittino, Fischnaller subito veloce allo Sliding Centre

-

Ovs prevede di chiudere l'anno con ricavi in crescita a 1,74 miliardi

-

'Amministrazione Trump contro Nike per discriminazione dipendenti bianchi'

'Amministrazione Trump contro Nike per discriminazione dipendenti bianchi'

-

'Consigliere diplomatico di Macron ha incontrato Ushakov ieri a Mosca'

-

Mosca, 'le parti del New Start non più vincolate dagli obblighi dell'accordo'

Mosca, 'le parti del New Start non più vincolate dagli obblighi dell'accordo'

-

Trump, 'Khamenei dovrebbe essere preoccupato ora'

-

On line i nuovi contributi 2026 per colf, badanti, baby sitter

On line i nuovi contributi 2026 per colf, badanti, baby sitter

-

Usa-Ue-Giappone annunciano partner strategica sui minerali critici

-

Media Israele, 'saltano i colloqui Usa-Iran, posizioni troppo distanti'

Media Israele, 'saltano i colloqui Usa-Iran, posizioni troppo distanti'

-

Ciclismo: Europei pista, due argenti per l'Italia dalle donne

-

Erdogan regala ad Al Sisi un'auto elettrica turca

Erdogan regala ad Al Sisi un'auto elettrica turca

-

Next Land e Stellantis, al via la Winter Camp

-

Se si dorme male in un letto nuovo, il segreto è in un gruppo di neuroni

Se si dorme male in un letto nuovo, il segreto è in un gruppo di neuroni

-

Da Acquirente Unico bond per 600 milioni. Pichetto, operazione di rilievo

-

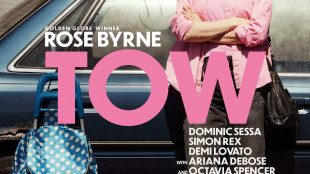

Rose Byrne, dalla corsa all'Oscar a una donna che vive in auto

Rose Byrne, dalla corsa all'Oscar a una donna che vive in auto

-

Fondazione Barilla, parte Grand Tour del Libro del Risparmio, recuperabili 500 euro l'anno

-

Serie A: Doveri dirigerà Verona-Pisa, Guida per Juve-Lazio

Serie A: Doveri dirigerà Verona-Pisa, Guida per Juve-Lazio

-

Borsa: Milano chiude poco sotto i 47mila punti, sprint di Mediobanca

-

Mit, campagna di richiamo Takata, 'verifica se il tuo veicolo è coinvolto'

Mit, campagna di richiamo Takata, 'verifica se il tuo veicolo è coinvolto'

-

Industria e ricerca insieme per non perdere le opportunità quantistiche

-

Borsa: Europa contrastata in chiusura, Parigi +1,01%, Francoforte -0,72%

Borsa: Europa contrastata in chiusura, Parigi +1,01%, Francoforte -0,72%

-

Una medaglia per il quarto posto, i bozzetti degli studenti dell'Ipzs

-

Confindustria punta sui giovani diplomatici, 'avvicinare imprese e diplomazia'

Confindustria punta sui giovani diplomatici, 'avvicinare imprese e diplomazia'

-

Xi a Trump, 'possiamo risolvere le questioni col rispetto reciproco'

-

Rubio, necessario includere missili balistici in negoziati con Iran

Rubio, necessario includere missili balistici in negoziati con Iran

-

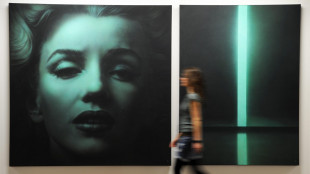

La casa di Marilyn Monroe, i proprietari fanno causa a Los Angeles

-

Stefano Bollani a Umbria jazz con All stars-tutta vita live

Stefano Bollani a Umbria jazz con All stars-tutta vita live

-

Love Me Love Me, il nuovo young adult e romance-triangle

-

Budapest condanna a 8 anni per violenza Maja T.

Budapest condanna a 8 anni per violenza Maja T.

-

Calcio: Tonolini sulla giornata degli arbitri, "bene giallo a McKennie"

-

L'assemblea di Mps approva le modifiche allo statuto

L'assemblea di Mps approva le modifiche allo statuto

-

Su Tmz le foto di Epstein morto in cella

-

Trump ritira 700 agenti federali dell'immigrazione da Minneapolis

Trump ritira 700 agenti federali dell'immigrazione da Minneapolis

-

Croce Rossa, 'salgono a 162 i morti dell'attacco in Nigeria'

-

Weekend al cinema, Shakespeare scalda il motore in vista dell'Oscar

Weekend al cinema, Shakespeare scalda il motore in vista dell'Oscar

-

Bonucci 'il bullismo neo della società che si manifesta in tanti modi'

-

Una nuova banca dati per il gemello europeo della Terra

Una nuova banca dati per il gemello europeo della Terra

-

Daniele Taddei nuovo Presidente dell'Unione Imprese Tecniche dell'Anica

-

Il tecnico sul mercato: 'Ho la rosa che volevo. Raspadori? Vediamo per la Coppa Italia'

Il tecnico sul mercato: 'Ho la rosa che volevo. Raspadori? Vediamo per la Coppa Italia'

-

Cargo russo al largo della Sardegna, la Nato monitora gli spostamenti

-

Borsa: Milano supera i 47mila punti, nuovo massimo da novembre 2000

Borsa: Milano supera i 47mila punti, nuovo massimo da novembre 2000

-

Cgil, è crisi per l'industria, oltre 131mila lavoratori coinvolti in tavoli Mimit

-

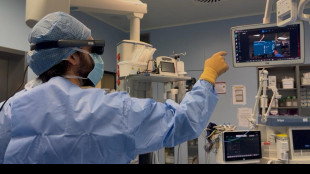

Nella chirurgia maxillo-facciale esordisce il visore di realtà aumentata

Nella chirurgia maxillo-facciale esordisce il visore di realtà aumentata

-

Meryl Streep sarà Joni Mitchell in un nuovo biopic di Cameron Crowe

-

Ismea, Italia primo esportatore mondiale di mele superati Usa e Cina in valore

Ismea, Italia primo esportatore mondiale di mele superati Usa e Cina in valore

-

Napoli: Di Lorenzo infortunato si opera a un piede

La capacità di giudizio dell'IA è solo apparenza

Grandi rischi nel delegare scelte e giudizi agli Llm

La capacità di giudizio dei modelli linguistici come ChatGpt o Gemini è solo apparenza: a dimostrarlo è lo studio guidato da Walter Quattrociocchi, dell'Università Sapienza di Roma, e pubblicato sulla rivista dell'Accademia Nazionale degli Stati Uniti Pnas. Un lavoro che sottolinea i rischi concreti di affidare a questi modelli di Intelligenza Artificiale la delega di fare scelte o prendere decisioni. "Cosa avviene realmente quando chiediamo a un'IA di eseguire una scelta, ad esempio determinare se una notizia del web sia credibile o è piuttosto una fake news?", ha detto Quattrociocchi all'ANSA per raccontare il nuovo studio che ha eseguito una serie di test a gran parte dei più importanti modelli linguisti Llm in circolazione, come ChatGpt, Gemini, Llama, Deepseek e Mistral. Un lungo lavoro che ha messo a confronto umani e IA per capire le differenze di 'ragionamento' dei due. "Quello che abbiamo messo qui molto bene in evidenza è che nonostante i risultati, le IA riconosco infatti molto bene le fake news, il meccanismo che utilizzano non si basa però su riscontri reali ma su una mera capacità di simulare i giudizi. In altre parole, i giudizi formulati dagli Llm sono plausibili ma disancorati dalla realtà fattuale". Una sostituzione della verità con la plausibilità che in un futuro non molto lontano, sottolineano gli autori, potrebbe portare a problemi gravi quando gradualmente daremo sempre più autorevolezza alle capacità degli Llm di gestire azioni o prendere scelte per noi, in totale delega. "Ma questi sistemi sembrano valutare come noi solo perché simulano le tracce del pensiero, non il pensiero stesso", ha aggiunto il ricercatore italiano. "Questo studio - ha concluso - dimostra che ciò che stiamo automatizzando non è il giudizio, ma la sua apparenza".

N.Awad--SF-PST