-

Bnp, utile 2025 sale a 12,2 miliardi, in trimestre +28%

Bnp, utile 2025 sale a 12,2 miliardi, in trimestre +28%

-

L'arcivescovo di Los Angeles prega per gli immigrati: 'Il Paese sappia accogliere'

-

Venezuela, il legale dell'ex ministro Alex Saab smentisce il suo arresto

Venezuela, il legale dell'ex ministro Alex Saab smentisce il suo arresto

-

Colombia, il Consiglio elettorale esclude Iván Cepeda dalle primarie della sinistra

-

Argentina-Usa, intesa sui minerali critici

Argentina-Usa, intesa sui minerali critici

-

Coppa Italia: Chivu, abbiamo sofferto un po' nel finale ma siamo contenti

-

Milano Cortina: slittino, Fischnaller subito veloce allo Sliding Centre

Milano Cortina: slittino, Fischnaller subito veloce allo Sliding Centre

-

Ovs prevede di chiudere l'anno con ricavi in crescita a 1,74 miliardi

-

'Amministrazione Trump contro Nike per discriminazione dipendenti bianchi'

'Amministrazione Trump contro Nike per discriminazione dipendenti bianchi'

-

'Consigliere diplomatico di Macron ha incontrato Ushakov ieri a Mosca'

-

Mosca, 'le parti del New Start non più vincolate dagli obblighi dell'accordo'

Mosca, 'le parti del New Start non più vincolate dagli obblighi dell'accordo'

-

Trump, 'Khamenei dovrebbe essere preoccupato ora'

-

On line i nuovi contributi 2026 per colf, badanti, baby sitter

On line i nuovi contributi 2026 per colf, badanti, baby sitter

-

Usa-Ue-Giappone annunciano partner strategica sui minerali critici

-

Media Israele, 'saltano i colloqui Usa-Iran, posizioni troppo distanti'

Media Israele, 'saltano i colloqui Usa-Iran, posizioni troppo distanti'

-

Ciclismo: Europei pista, due argenti per l'Italia dalle donne

-

Erdogan regala ad Al Sisi un'auto elettrica turca

Erdogan regala ad Al Sisi un'auto elettrica turca

-

Next Land e Stellantis, al via la Winter Camp

-

Se si dorme male in un letto nuovo, il segreto è in un gruppo di neuroni

Se si dorme male in un letto nuovo, il segreto è in un gruppo di neuroni

-

Da Acquirente Unico bond per 600 milioni. Pichetto, operazione di rilievo

-

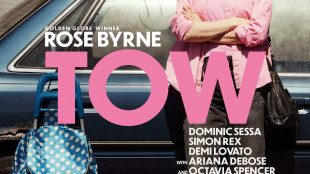

Rose Byrne, dalla corsa all'Oscar a una donna che vive in auto

Rose Byrne, dalla corsa all'Oscar a una donna che vive in auto

-

Fondazione Barilla, parte Grand Tour del Libro del Risparmio, recuperabili 500 euro l'anno

-

Serie A: Doveri dirigerà Verona-Pisa, Guida per Juve-Lazio

Serie A: Doveri dirigerà Verona-Pisa, Guida per Juve-Lazio

-

Borsa: Milano chiude poco sotto i 47mila punti, sprint di Mediobanca

-

Mit, campagna di richiamo Takata, 'verifica se il tuo veicolo è coinvolto'

Mit, campagna di richiamo Takata, 'verifica se il tuo veicolo è coinvolto'

-

Industria e ricerca insieme per non perdere le opportunità quantistiche

-

Borsa: Europa contrastata in chiusura, Parigi +1,01%, Francoforte -0,72%

Borsa: Europa contrastata in chiusura, Parigi +1,01%, Francoforte -0,72%

-

Una medaglia per il quarto posto, i bozzetti degli studenti dell'Ipzs

-

Confindustria punta sui giovani diplomatici, 'avvicinare imprese e diplomazia'

Confindustria punta sui giovani diplomatici, 'avvicinare imprese e diplomazia'

-

Xi a Trump, 'possiamo risolvere le questioni col rispetto reciproco'

-

Rubio, necessario includere missili balistici in negoziati con Iran

Rubio, necessario includere missili balistici in negoziati con Iran

-

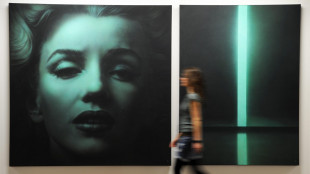

La casa di Marilyn Monroe, i proprietari fanno causa a Los Angeles

-

Stefano Bollani a Umbria jazz con All stars-tutta vita live

Stefano Bollani a Umbria jazz con All stars-tutta vita live

-

Love Me Love Me, il nuovo young adult e romance-triangle

-

Budapest condanna a 8 anni per violenza Maja T.

Budapest condanna a 8 anni per violenza Maja T.

-

Calcio: Tonolini sulla giornata degli arbitri, "bene giallo a McKennie"

-

L'assemblea di Mps approva le modifiche allo statuto

L'assemblea di Mps approva le modifiche allo statuto

-

Su Tmz le foto di Epstein morto in cella

-

Trump ritira 700 agenti federali dell'immigrazione da Minneapolis

Trump ritira 700 agenti federali dell'immigrazione da Minneapolis

-

Croce Rossa, 'salgono a 162 i morti dell'attacco in Nigeria'

-

Weekend al cinema, Shakespeare scalda il motore in vista dell'Oscar

Weekend al cinema, Shakespeare scalda il motore in vista dell'Oscar

-

Bonucci 'il bullismo neo della società che si manifesta in tanti modi'

-

Una nuova banca dati per il gemello europeo della Terra

Una nuova banca dati per il gemello europeo della Terra

-

Daniele Taddei nuovo Presidente dell'Unione Imprese Tecniche dell'Anica

-

Il tecnico sul mercato: 'Ho la rosa che volevo. Raspadori? Vediamo per la Coppa Italia'

Il tecnico sul mercato: 'Ho la rosa che volevo. Raspadori? Vediamo per la Coppa Italia'

-

Cargo russo al largo della Sardegna, la Nato monitora gli spostamenti

-

Borsa: Milano supera i 47mila punti, nuovo massimo da novembre 2000

Borsa: Milano supera i 47mila punti, nuovo massimo da novembre 2000

-

Cgil, è crisi per l'industria, oltre 131mila lavoratori coinvolti in tavoli Mimit

-

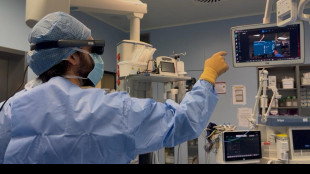

Nella chirurgia maxillo-facciale esordisce il visore di realtà aumentata

Nella chirurgia maxillo-facciale esordisce il visore di realtà aumentata

-

Meryl Streep sarà Joni Mitchell in un nuovo biopic di Cameron Crowe

Scienziati sollecitano i Paesi Onu, 'limiti a usi pericolosi IA'

'Agire entro 2026 o difficile controllo umano significativo'

Oltre 200 personalità di spicco tra cui premi Nobel e ricercatori che lavorano presso giganti dell'Intelligenza artificiale come Anthropic, Google, Microsoft e OpenAI, hanno firmato il documento 'Global Call for AI Red Lines' rivolto ai Paesi presenti all'Assemblea Generale delle Nazioni Unite in cui invitano a stabilire rapidamente, entro il 2026, 'linee rosse' da non oltrepassare per l'IA e gli usi pericolosi. "L'Intelligenza artificiale ha un immenso potenziale per migliorare il benessere umano, ma la sua attuale traiettoria presenta pericoli senza precedenti - si legge nel documento che tra i firmati vede Geoffrey Hinton e Yoshua Bengio, considerati tra i padri dell'IA -. I governi devono agire con decisione prima che si chiuda la finestra per un intervento significativo". Secondo gli autori della lettera, le 'linee rosse' per l'IA sarebbero divieti concordati a livello internazionale su usi considerati troppo rischiosi tra cui l'affidamento all'intelligenza artificiale del comando di arsenali nucleari o di qualsiasi tipo di sistema d'arma autonomo letale. Oppure l'uso dell'IA per la sorveglianza di massa, gli attacchi informatici e i deepfake. I firmatari del messaggio hanno esortato i governi a stabilire limiti all'IA entro la fine del prossimo anno dato il ritmo a cui avanza la tecnologia. "L'Intelligenza artificiale potrebbe presto superare di gran lunga le capacità umane e aumentare rischi come pandemie ingegnerizzate, disinformazione diffusa, manipolazione su larga scala di individui, compresi i bambini, problemi di sicurezza nazionale e internazionale, disoccupazione di massa e sistematiche violazioni dei diritti umani", si legge nella lettera. "Se non si interviene, molti esperti compresi quelli in prima linea nello sviluppo, avvertono che diventerà sempre più difficile esercitare un controllo umano significativo nei prossimi anni".

K.AbuTaha--SF-PST