-

Presidente della Fondazione Museo della Shoah alla Giornata della Memoria in Canada

Presidente della Fondazione Museo della Shoah alla Giornata della Memoria in Canada

-

All'asta la chitarra di Kurt Cobain, 'può valere fino a 5 milioni'

-

Coppa Italia: Juventus battuta 3-0, Atalanta in semifinale

Coppa Italia: Juventus battuta 3-0, Atalanta in semifinale

-

Essere scelti e fragilità, Cesare Cremonini incontra gli studenti Unical

-

Milano Cortina: Piazza Duomo accoglie la fiamma, acceso il braciere

Milano Cortina: Piazza Duomo accoglie la fiamma, acceso il braciere

-

Il 'teatrante militante' Servillo ai giovani: camminate insieme

-

Dalla Via Lattea il principale indizio delle origini cosmiche della vita sulla Terra

Dalla Via Lattea il principale indizio delle origini cosmiche della vita sulla Terra

-

Zelensky, 'probabilmente in Usa i prossimi colloqui'

-

In Fvg prime banchine portuali in Italia elettrificate con fotovoltaico

In Fvg prime banchine portuali in Italia elettrificate con fotovoltaico

-

Europei pallanuoto: Setterosa ko, il bronzo va alla Grecia

-

Ghali, 'non ho più potuto cantare l'inno d'Italia'

Ghali, 'non ho più potuto cantare l'inno d'Italia'

-

Mosca, 'accuse di Tajani su cyberattacchi sono calunnie'

-

Il governo Milei lancia il suo ufficio 'contro la disinformazione'

Il governo Milei lancia il suo ufficio 'contro la disinformazione'

-

Fonti Farnesina ad amb. Mosca, 'cyberattacchi rivendicati da filorussi'

-

Salvezza possibile per il cielo più buio e limpido al mondo

Salvezza possibile per il cielo più buio e limpido al mondo

-

Borsa: Milano debole con Wall street e l'Europa, male Stellantis e le banche

-

Il gas conclude in leggero rialzo (+0,7%) a 33,7 euro al Megawattora

Il gas conclude in leggero rialzo (+0,7%) a 33,7 euro al Megawattora

-

Enel, nel 2025 mol ordinario +2,2%, utile netto fra 6,7 e 6,9 miliardi

-

Lula, il rientro di Maduro in Venezuela 'non è la principale preoccupazione'

Lula, il rientro di Maduro in Venezuela 'non è la principale preoccupazione'

-

Confapi, roadshow con Sace e Simest per l'internazionalizzazione delle pmi

-

Pirelli boccia la proposta dei cinesi di Cnrc su Cyber Tyre

Pirelli boccia la proposta dei cinesi di Cnrc su Cyber Tyre

-

Milano 84 rilegge gli anni '80 con Nostaljoy two

-

Borsa: l'Europa conclude debole, Madrid -2,1%

Borsa: l'Europa conclude debole, Madrid -2,1%

-

Borsa: Milano chiude in forte calo, Ftse Mib -1,75%

-

Ai piedi del Monviso delle insolite stalagmiti di ghiaccio

Ai piedi del Monviso delle insolite stalagmiti di ghiaccio

-

Golino, 'nella fragilità di Gioia ho messo la mia anima'

-

Europei pista: Balsamo e Venturelli bronzo nella madison

Europei pista: Balsamo e Venturelli bronzo nella madison

-

Regina (Confindustria), dal nucleare dipendono competività e benessere

-

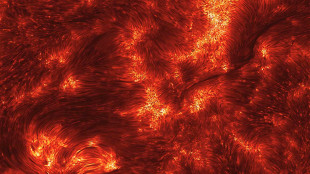

Brillamenti solari come le valanghe, al via da piccole perturbazioni

Brillamenti solari come le valanghe, al via da piccole perturbazioni

-

Sei Nazioni: Quesada 'l'immagine è cambiata, oggi è sorpresa se vince la Scozia'

-

Borsa: l'Europa resta debole dopo Wall street, Milano molto nervosa

Borsa: l'Europa resta debole dopo Wall street, Milano molto nervosa

-

Parisi, sbagliato tornare al nucleare, puntiamo sul solare

-

Fifa: mercato di riparazione, solo la Premier spende piu' della serie A

Fifa: mercato di riparazione, solo la Premier spende piu' della serie A

-

Calcio: Vergara, 'con Conte come a scuola, mi insegna a non staccare mai la testa'

-

Atletica: domani Battocletti a Madrid, esordio indoor nei 1.500

Atletica: domani Battocletti a Madrid, esordio indoor nei 1.500

-

Wall Street apre in calo, Dj -0,49%, Nasdaq -1,37%

-

Il petrolio è in calo a New York a 63,48 dollari

Il petrolio è in calo a New York a 63,48 dollari

-

Salmo annuncia l'album Hellvisback 10 years later

-

Milano Cortina: ampia copertura su Sky, la Casa dello sport diventa 'Casa Italia'

Milano Cortina: ampia copertura su Sky, la Casa dello sport diventa 'Casa Italia'

-

Al via le celebrazioni per i 50 anni del Metodo Suzuki in Italia

-

Haftar e Hammad in Pakistan, allo studio consolato a Bengasi

Haftar e Hammad in Pakistan, allo studio consolato a Bengasi

-

Borsa: Milano (-1,3%) e l'Europa peggiorano in attesa di Wall street

-

Strumento di IA può 'leggere' l'età del cervello ed il rischio Alzheimer

Strumento di IA può 'leggere' l'età del cervello ed il rischio Alzheimer

-

Tropico in concerto a Pompei per la rassegna 'B.O.P. 2026'

-

Ditonellapiaga annuncia la release del nuovo album Miss Italia, fuori il 10 aprile

Ditonellapiaga annuncia la release del nuovo album Miss Italia, fuori il 10 aprile

-

Codacons, rischio spegnimento non solo autovelox ma anche tutor in autostrada

-

Lagarde, sul commercio internazionale pesano i dazi e l'euro forte

Lagarde, sul commercio internazionale pesano i dazi e l'euro forte

-

Aviaria, Veneto prima regione italiana ad avviare la campagna vaccinale in allevamenti

-

A Roma Accademia Bizantina con i Concerti Brandeburghesi

A Roma Accademia Bizantina con i Concerti Brandeburghesi

-

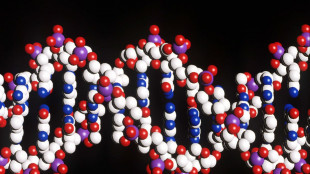

Errori nella riparazione del Dna alla base della perdita di abilità

Uno studio esplora come rendere l'IA meno energivora

Pubblicazione su Jstat indaga efficacia del curriculum learning

Più biglietti della lotteria compri, maggiori sono le probabilità di vincere, ma spendere più di quanto guadagni non è una strategia saggia: qualcosa di simile accade nell'IA basata sul deep learning: più grande è una rete neurale, meglio può apprendere il compito assegnato. Purtroppo però rendere una rete infinitamente grande durante l'addestramento è impossibile e inefficiente. I cervelli biologici apprendono attraverso un processo parco nell'uso delle risorse che si è provato a imitare fornendo alle macchine un addestramento graduale, che parte da esempi semplici e progredisce verso quelli complessi (curriculum learning): una strategia sensata ma irrilevante per le reti molto grandi. Lo studio pubblicato sul Journal of Statistical Mechanics: Theory and Experiment (Jstat), uno dei giornali della Sissa/Iop, ha cercato di capire il perché di questo fallimento, suggerendo che queste reti sovraparametrizzate sono talmente ricche da sfruttare spontaneamente un percorso di apprendimento basato più sulla quantità di risorse che sulla loro qualità. Questa osservazione suggerisce che, regolando la dimensione iniziale della rete, il curriculum learning potrebbe rivelarsi una strategia valida, da sfruttare per creare reti neurali meno energeticamente dispendiose. "Ciò che abbiamo osservato è che una rete neurale sopra parametrizzata non ha bisogno di un percorso di apprendimento, perché, invece di essere guidata dagli esempi, è guidata dal fatto che dispone già di tante risorse—parametri che per caso si trovano già vicini a una soluzione, che vengono imboccati spontaneamente", osserva Luca Saglietti, fisico dell'Università Bocconi di Milano, che ha coordinato lo studio. Questo non significa che le reti non possano beneficiare del curriculum learning, ma che, data l'alta quantità di parametri iniziali, sono spinte in una direzione diversa. In teoria quindi si potrebbe trovare un modo per iniziare con reti più piccole e adottare il curriculum learning. "Questa è una parte dell'ipotesi esplorata nel nostro studio", rileva Saglietti. "Almeno negli esperimenti che abbiamo condotto, abbiamo osservato che, iniziando con reti più piccole, l'effetto del curriculum inizia a migliorare le prestazioni rispetto a quando l'input viene fornito casualmente. Questo miglioramento è maggiore rispetto a quando si continua ad aumentare i parametri fino al punto in cui l'ordine degli input non importa più".

I.Saadi--SF-PST