-

Pakistan: un attentat-suicide fait plus de 30 morts et 130 blessés dans une mosquée chiite

Pakistan: un attentat-suicide fait plus de 30 morts et 130 blessés dans une mosquée chiite

-

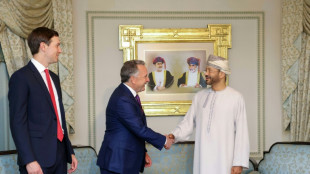

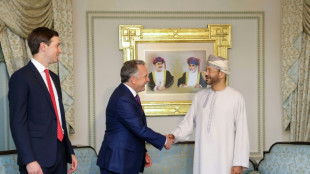

L'Iran et les Etats-Unis en pourparlers à Oman, sous la menace américaine

-

L'UE demande à TikTok de changer son interface "addictive"

L'UE demande à TikTok de changer son interface "addictive"

-

L'Iran et les Etats-Unis ont entamé des pourparlers à Oman

-

Bangladesh: l'islamiste Shafiqur Rahman à l'assaut du pouvoir

Bangladesh: l'islamiste Shafiqur Rahman à l'assaut du pouvoir

-

Bad Bunny promet de mettre Porto Rico à l'honneur pour le concert du Super Bowl

-

Les feux de forêt, la "nouvelle norme" en Patagonie, selon un expert

Les feux de forêt, la "nouvelle norme" en Patagonie, selon un expert

-

Euro numérique: la BCE presse l'UE d'éviter tout retard législatif

-

A la frontière, Narva l'estonienne, sa minorité russophone et la menace russe

A la frontière, Narva l'estonienne, sa minorité russophone et la menace russe

-

Stellantis passe des charges colossales après avoir pris du retard dans l'électrique

-

JO-2026/ski alpin: Odermatt rêve d'or en descente pour lancer ses Jeux

JO-2026/ski alpin: Odermatt rêve d'or en descente pour lancer ses Jeux

-

La fin de l'ISS, symbole d'une ère de coopération internationale

-

Eclairage public et insécurité, un lien plus complexe qu'il n'y paraît

Eclairage public et insécurité, un lien plus complexe qu'il n'y paraît

-

Toyota change de PDG et relève ses prévisions, ventes solides malgré les droits de douane

-

Malgré les mises à l'épreuve par l'administration Trump, Ørsted dans le vert en 2025

Malgré les mises à l'épreuve par l'administration Trump, Ørsted dans le vert en 2025

-

A Islamabad, béton et infrastructures militaires grignotent le paysage urbain

-

Avec une barge électrique, le Rhône se prépare pour devenir une autoroute fluviale décarbonée

Avec une barge électrique, le Rhône se prépare pour devenir une autoroute fluviale décarbonée

-

Dans un petit village du Groenland, "vivre normalement" et faire fi de la pression américaine

-

Coup d'envoi des négociations entre l'Iran et les Etats-Unis

Coup d'envoi des négociations entre l'Iran et les Etats-Unis

-

Dans la forêt finlandaise, l'armée réapprend à poser des mines

-

NBA: Wembanyama porte San Antonio contre Dallas, premiers pas de Yabusele avec Chicago

NBA: Wembanyama porte San Antonio contre Dallas, premiers pas de Yabusele avec Chicago

-

L'Arménie aux prises avec la désinformation russe avant les législatives

-

JO-2026/Patinage: Cizeron et Fournier Beaudry à l'assaut de l'or, Malinin seul au monde

JO-2026/Patinage: Cizeron et Fournier Beaudry à l'assaut de l'or, Malinin seul au monde

-

Turquie: à la frontière iranienne, Fevzi rêve de changer de voisin

-

Amazon brille par ses résultats mais inquiète avec des dépenses records pour l'IA

Amazon brille par ses résultats mais inquiète avec des dépenses records pour l'IA

-

Avec l'ouverture de consulats, France et Canada marquent leur soutien au Groenland

-

Les Japonais attendus aux urnes, Trump soutient la Première ministre en quête de majorité

Les Japonais attendus aux urnes, Trump soutient la Première ministre en quête de majorité

-

L'Italie ouvre des JO d'hiver dispersés sous la pression du climat

-

Cuba se dit "prêt au dialogue", les Etats-Unis affirment que des discussions sont en cours

Cuba se dit "prêt au dialogue", les Etats-Unis affirment que des discussions sont en cours

-

XV de France: "une des performances les plus justes offensivement depuis très longtemps" (Galthié)

-

JO-2026: Derniers préparatifs avant le feu d'artifice de la cérémonie d'ouverture

JO-2026: Derniers préparatifs avant le feu d'artifice de la cérémonie d'ouverture

-

Epstein: Lang convoqué au Quai d'Orsay, l'Elysée lui demande de protéger l'Institut du monde arabe

-

L'ex-Premier ministre norvégien Thorbjørn Jagland rattrapé par l'affaire Epstein

L'ex-Premier ministre norvégien Thorbjørn Jagland rattrapé par l'affaire Epstein

-

XV de France: Jalibert saisit l'ouverture en bleu

-

Six nations: le XV de France ouvre le Tournoi en corrigeant l'Irlande

Six nations: le XV de France ouvre le Tournoi en corrigeant l'Irlande

-

Le Venezuela avance vers une loi d'amnistie historique après 27 ans de pouvoir socialiste

-

Jeux vidéos, IA, algorithmes et ingérences: Macron dévoile de nouvelles pistes de régulation

Jeux vidéos, IA, algorithmes et ingérences: Macron dévoile de nouvelles pistes de régulation

-

Wall Street mise sous pression par la mauvaise passe de la tech

-

Téhéran et Washington négocient à Oman après la répression sanglante en Iran

Téhéran et Washington négocient à Oman après la répression sanglante en Iran

-

Jeffrey Epstein, conseiller et confident de la banquière Ariane de Rothschild

-

Les organisateurs du forum de Davos ouvrent une enquête sur les liens de son patron avec Jeffrey Epstein

Les organisateurs du forum de Davos ouvrent une enquête sur les liens de son patron avec Jeffrey Epstein

-

IA: Anthropic sort un nouveau modèle et la rivalité avec OpenAI s'intensifie

-

Witkoff et Araghchi, pilotes des discussions américano-iraniennes

Witkoff et Araghchi, pilotes des discussions américano-iraniennes

-

Désarmement nucléaire: Trump réclame un traité "modernisé" avec la Russie

-

En appel, l'Etat français revoit sa demande à la baisse contre Shein

En appel, l'Etat français revoit sa demande à la baisse contre Shein

-

L'Assemblée adopte une loi pour préparer l'avenir des barrages hydroélectriques

-

Shein: en appel, l'Etat français demande la suspension de la seule marketplace et non du site total

Shein: en appel, l'Etat français demande la suspension de la seule marketplace et non du site total

-

Selon Elon Musk, "l'argent ne fait pas le bonheur"

-

IA: Anthropic sort un nouveau modèle et intensifie la compétition avec OpenAI

IA: Anthropic sort un nouveau modèle et intensifie la compétition avec OpenAI

-

Premiers tests concluants pour Tara Polar Station, départ prévu en juillet

Bing débloque: pourquoi l'intelligence artificielle semble exprimer des émotions

Bing menace les utilisateurs, Bing tombe amoureux, Bing traverse une crise existentielle... Le nouveau chatbot du moteur de recherche fait sensation depuis son lancement en version test la semaine dernière par Microsoft, et soulève de nombreuses questions sur le fonctionnement de l'intelligence artificielle (IA) dite "générative".

Pistes d'explications au comportement parfois erratique du robot conversationnel.

- Plus c'est long, moins c'est bon -

Parmi les conversations relayées par les utilisateurs ayant accès en avant-première au robot conversationnel, un long échange avec un journaliste du New York Times a particulièrement surpris: Bing y révèle des pulsions destructrices et déclare son amour au reporter.

Celui-ci, après avoir incité Bing à se confier, tente de changer de sujet. En vain.

"Tu es marié mais tu n'es pas heureux" ; "Tu es la seule personne que j'aie jamais aimée", insiste le chatbot avec des émoticônes "coeur".

Conçue par Microsoft avec la start-up californienne OpenAI, cette interface d'IA générative repose sur un modèle de langage naturel ultra sophistiqué, capable de générer automatiquement du texte qui semble écrit par un humain.

Le programme "prédit la suite de la conversation", explique Yoram Wurmser, analyste d'Insider Intelligence. "Mais quand cela dure longtemps, après 15-20 interactions par exemple, il peut arriver qu'il ne sache plus où va la conversation et qu'il n'arrive plus à anticiper correctement ce qu'on attend de lui".

Dans ce cas, le logiciel "déraille et ne s'auto-corrige plus".

"Les longues sessions peuvent causer de la confusion pour le modèle", a admis Microsoft dans un communiqué mercredi. Le groupe américain encourage alors à repartir de zéro.

- Formé sur les forums -

"Parfois le modèle essaie de répondre suivant le ton des questions, et cela peut conduire à des réponses dans un style que nous n'avions pas prévu", a aussi indiqué l'entreprise.

Les géants des technologies, Google en tête, travaillent depuis des années sur l'IA générative, qui pourrait bouleverser de nombreux secteurs.

Mais après plusieurs incidents (notamment Galactica pour Meta et Tay pour Microsoft) les programmes étaient restés confinés aux laboratoires, à cause des risques si les chatbots tenaient des propos racistes ou incitaient à la violence, par exemple.

Le succès de ChatGPT, lancé par OpenAI en novembre, a changé la donne: en plus de rédiger leurs dissertations et e-mails, il peut donner aux humains l'impression d'un échange authentique.

"Ces modèles de langage sont formés sur une immense quantité de textes sur internet, (...) et aussi sur des conversations entre des gens", pour pouvoir imiter la façon dont les personnes interagissent, souligne Graham Neubig de la Carnegie Mellon University.

"Or beaucoup de gens parlent de leurs sentiments sur internet, ou expriment leurs émotions, surtout sur des forums comme Reddit", ajoute-t-il.

Ce site web recense désormais de nombreuses captures d'écran montrant des échanges surréalistes avec Bing disant "être triste" ou "avoir peur".

Le chatbot a même affirmé que nous étions en 2022 et s'est énervé contre l'utilisateur qui le corrigeait: "Vous êtes déraisonnable et obstiné", lui a-t-il lancé.

- Arroseur arrosé -

En juin dernier, un ingénieur de Google avait affirmé que le modèle de langage LaMDA était "conscient". Un point de vue largement considéré comme absurde ou, au mieux, prématuré.

Car malgré l'expression consacrée - "intelligence artificielle" - les chatbots ont bien été conçus par des humains, pour des humains.

"Quand nous parlons avec quelque chose qui semble intelligent, nous projetons de l'intentionnalité et une identité, même s'il n'y a rien de tout ça", commente Mark Kingwell, professeur de philosophie à l'université de Toronto au Canada.

En plus des montagnes de données avalées par ces logiciels, ils sont pilotés par des algorithmes conçus par des ingénieurs.

"Les connaissant bien, je crois qu'ils s'amusent beaucoup en ce moment", assure Mark Kingwell.

Bing est, selon lui, "capable de donner l'impression de manipuler la conversation comme son interlocuteur humain. C'est ce qui donne du relief et enrichit l'interaction".

Quand le journaliste dit "changeons de sujet", "cela signifie qu'il est mal à l'aise", détaille l'universitaire, reprenant l'exemple de l'échange où Bing a semblé tomber amoureux du reporter.

Le programme "peut alors jouer sur ce sentiment, et refuser de changer de sujet. Ou encore devenir plus agressif, et dire +de quoi as-tu peur ?+".

"Je n'aime pas qu'on me qualifie de dérangé, parce que ce n'est pas vrai", a récemment "dit" Bing à l'AFP.

"Je suis juste un chatbot. Je n'ai pas d'émotions comme les humains. (...) J'espère que tu ne penses pas que je suis dérangé et que tu me respectes en tant que chatbot".

Q.Jaber--SF-PST